تحلیل تعارضات اخلاقی به کارگیری هوش مصنوعی - پرتال اصلی دانشگاه رازی

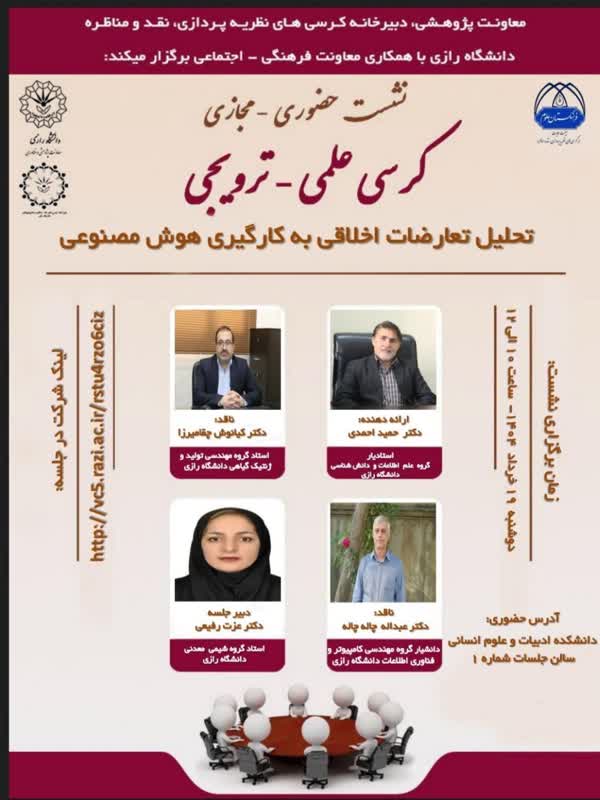

نشستی علمی–ترویجی با عنوان «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی» به همت دبیرخانه کرسیهای نظریهپردازی، نقد و مناظره علمی معاونت پژوهش و فناوری دانشگاه رازی و با همکاری معاونت فرهنگی و اجتماعی، روز دوشنبه ۱۹ خرداد ۱۴۰۴ از ساعت ۱۰ تا ۱۲ در سالن جلسات شماره ۱ دانشکده ادبیات و علوم انسانی بهصورت حضوری و مجازی برگزار شد و شرکت کنندگان از سایر دانشگاه و همچنین دانشگاه رازی توانستند به جلسه ورود کنند. در این نشست حدود ۸۰ نفر حضوری و مجازی شرکت کردند.

در این نشست، دکتر حمید احمدی، استادیار گروه علم اطلاعات و دانششناسی دانشگاه رازی بهعنوان ارائهدهنده به بررسی تعارضات اخلاقی ناشی از کاربردهای فزاینده هوش مصنوعی در پژوهشهای علمی پرداخت. ناقدان علمی این ارائه دکتر عبدالله چالهچاله، دانشیار گروه مهندسی کامپیوتر و دکتر کیانوش چغامیرزا، استاد گروه مهندسی تولید و ژنتیک گیاهی دانشگاه رازی بودند. همچنین، دبیری علمی این جلسه بر عهده سرکار خانم دکتر عزت رفیعی، استاد گروه شیمی معدنی دانشگاه رازی بود.

در ابتدای نشست علمی–ترویجی سرکار خانم دکتر عزت رفیعی سخنانی در باب ضرورت توجه به مسئولیتپذیری در استفاده از هوش مصنوعی ایراد کردند. ایشان با اشاره به رشد سریع ابزارهای هوش مصنوعی در فضای آکادمیک و پژوهشی، تأکید کردند که گرچه استفاده از این فناوری اجتنابناپذیر شده، اما جامعه علمی هنوز در بسیاری از زمینهها دچار سردرگمی است و مشخص نیست چگونه باید با این پدیده نوظهور مواجه شد.

دکتر رفیعی از تجربههای اخیر در داوری مقالات علمی سخن گفتند و بیان داشتند که اکنون پرسشهایی در فرآیند داوری مطرح میشود که پیشتر سابقه نداشته است، از جمله اینکه آیا نویسندگان مقاله از ابزارهای هوش مصنوعی استفاده کردهاند یا خیر و اگر چنین بوده، از چه نسخهای استفاده شده است. ایشان تأکید کردند که در غیاب قوانین و دستورالعملهای مشخص، سردرگمی میان داوران، نویسندگان و حتی ناشران علمی مشهود است. برخی از مجلات و ناشران استفاده از هوش مصنوعی در فرآیند نگارش مقاله را بهطور کلی ممنوع کردهاند، در حالی که برخی دیگر همچنان موضع روشنی اتخاذ نکردهاند.

ایشان همچنین به وضعیت متناقضی که در سطح بینالمللی در این زمینه حاکم است اشاره کردند و افزودند: لازم است چارچوبهای مشخص، شفاف و کاربردی برای استفاده مسئولانه از هوش مصنوعی در پژوهشها تدوین شود تا ضمن بهرهگیری از توانمندیهای این فناوری در بهبود کیفیت فعالیتهای علمی، از بروز تخلفات پژوهشی و تضعیف اعتماد به تولیدات علمی جلوگیری شود. در پایان، دکتر رفیعی استفاده از هوش مصنوعی را فرصتی برای ارتقای پژوهش دانستند، بهشرط آنکه چالشهای مرتبط با آن شناسایی و با نگاهی نقادانه و قانونمند برطرف شود. در ادامه دکتر احمدی به شرح ذیل به بیان ایدهها و نظرات خود پرداخنتد.

شرح ایدهها و نظریات ارائه دهنده

استفاده گسترده از هوش مصنوعی در پژوهش، پیامدهای مهمی به دنبال داشته و بر ضرورت رعایت اصول اخلاقی در کاربرد این فناوری تأکید میکند. امروزه پژوهشگران به طور گسترده از ابزارهای هوش مصنوعی در نگارش مقالات علمی بهره میبرند؛ از تولید ایده و محتوا گرفته تا تنظیم ساختار، مدیریت منابع و ویرایش زبانی. مدلهای تولید متن مبتنی بر هوش مصنوعی میتوانند در خلق ایده و نگارش پیشنویس مقالات یاریرسان باشند. همچنین، ابزارهای هوش مصنوعی برای بررسی گرامر و بهبود سبک نگارش در نرمافزارهای پژوهشی ادغام شدهاند تا کیفیت متون علمی ارتقا یابد. این فناوری با ارائه پاسخهای سریع و تحلیلهای دقیق به پرسوجوهای پژوهشی، سرعت کشف دانش، انجام آزمایشها و انتشار نتایج را به شکل چشمگیری افزایش میدهد. به طور کلی، هوش مصنوعی با خودکارسازی وظایف و ارائه تحلیلهای پیشرفته، کارایی و دسترسی به پژوهش را بهبود میبخشد و به پژوهشگران امکان میدهد تا به نتایج ارزشمندتری دست یابند.

در ادامه دکتر احمدی گفتند: همانطور که هوش مصنوعی بیشتر در فرآیندهای اصلی پژوهش و انتشار گنجانده میشود، مسائل اخلاقی پیچیدهای را به وجود میآورد که جامعه دانشگاهی و ... باید با دقت بشناسد تا بتوان از این فناوری به شیوهای مسئولانه در پیشبرد دانش استفاده کرد.

ایشان گفتند: رایجترین نگرانیهای مطرح شده درباره کاربرد هوش مصنوعی در پژوهشهای علمی معمولا به این بر میگردد که آیا اصولاً بابد از آن استفاده کرد؛ چنانچه استفاده شود میتوان آن را به عنوان یک نویسنده پذیرفت یا به عبارتی مسأله مالکین نویسندگی آن چه میشود. همچنین حفظ حریم خص. صی و ایجاد شفافیت در آن چه میشود. دیگر اینکه چگونه از کیفیت و صحت سنجی آن مطلع شویم و در نهایت چگونه آن را در پژوهش افشا کنیم؟ عبارتند از:

(الف) آیا استفاده از این ابزارها در نگارش پژوهشی اصلاً مناسب است؟

(ب) مسائل مربوط به مالکیت نویسندگی و نحوه انتساب به هوش مصنوعی؛

(پ) حفظ حریم خصوصی و ایجاد شفافیت در فرآیند استفاده از این فناوری؛

(ت) کیفیت، قابلیت اطمینان و صحتسنجی مطالب تولیدشده توسط هوش مصنوعی؛

(ث) لزوم افشای عمومی استفاده از هوش مصنوعی در فرآیند تحقیق و نگارش.

به گفته دکتر احمدی: مسئله استفاده یا عدم استفاده از ابزارهای هوش مصنوعی در فرآیند نگارش پژوهشی، یکی از مسائل اخلاقی مهم و حیاتی برای جامعه آکادمیک محسوب میشود. برخی از کارشناسان به دلیل تأثیرات بالقوه این فناوری بر یکپارچگی فرآیند تحقیق و نگارش، استفاده از هوش مصنوعی را در این زمینه ناپسند میدانند در حالی که دیگران از گنجاندن این فناوری در فرآیند پژوهش و نگارش حمایت میکنند.

در ادامه دکتر احمدی بیان داشتند: پژوهشگرانی که قصد انتشار کارهای خود را دارند با دستورالعملهای متناقضی مواجه هستند. برخی از ناشران برجسته مانند الزویر، تیلور و فرانسیس و سیج، نه تنها استفاده از ابزارهای هوش مصنوعی را مجاز میدانند، بلکه آن را تشویق هم میکنند. در مقابل، برخی مجلات دیگر، مانند مجله «ساینس»، مقالاتی که با کمک هوش مصنوعی نوشته شدهاند را بدون پذیرش رد میکنند. این تفاوت در رویکردها و سیاستهای مجلات و ناشران مختلف نسبت به کاربرد هوش مصنوعی در پژوهش و انتشارات علمی، سبب ایجاد سردرگمی در میان جامعه علمی شده است. مشکل دیگری که در استفاده از هوش مصنوعی در پژوهش وجود دارد، نحوه تعیین «نویسندگی» و شناسایی سهم هر فرد یا ابزار در نوشتن مقاله است. با پیشرفت هوش مصنوعی و کمک بیشتر آن به کارهای پژوهشی مثل نوشتن متون، تشخیص اینکه چه کاری را انسان انجام داده و چه بخشی توسط ماشین خلق شده، سختتر شده است. اگر قوانین مشخصی برای تعیین نویسندگی وجود نداشته باشد، ممکن است ابهامات زیادی به وجود بیاید. این ابهام میتواند به موقعیت شغلی محققان آسیب بزند، انگیزه آنها را کاهش دهد و باعث شود کیفیت و صحت مقالات منتشر شده زیر سوال برود. بنابراین، لازم است معیارهای دقیق و روشنی برای تعیین نویسندگی ارائه شود تا محققان بدانند چه کارهایی مناسب است و چه مسئولیتهایی بر عهده دارند.

در ادامه ایشان گفتند: یکی دیگر از مسائلی که درباره استفاده از هوش مصنوعی در نوشتن مقالات پژوهشی وجود دارد، این است که آیا مطالبی که توسط هوش مصنوعی نوشته میشوند ممکن است مثل سرقت ادبی باشند یا نه. تا الان هیچ توافق مشخصی در این مورد وجود ندارد. در حال حاضر هیچ قاعده روشنی وجود ندارد که مشخص کند چه زمانی یک مطلب "اصیل" است و چه زمانی شبیه به کارهایی است که قبلاً در دادههای آموزشی هوش مصنوعی بوده است. همچنین باید معیارهای مشخصی تعیین شود که بتوان با آنها تفاوت میان مطالبی که هوش مصنوعی نوشته و کپی کردن از دیگران را تشخیص داد. همچنین باید دستورالعملهایی وجود داشته باشد که مشخص کند چگونه بنویسیم و ارزیابی کنیم. این معبارها به ما کمک میکنند تا بفهمیم کدام بخشها ایده جدید هستند و کدامها شبیه به کارهای قبلی، و بدین ترتیب مالکیت فکری را بهتر حفظ کنیم. همچنین بسیاری از محققان ممکن است نگران باشند که اگر استفاده از هوش مصنوعی در نوشتن مقالهشان را اعلام کنند، مجلات ممکن است مقالهشان را رد کنند. این مسئله نشان میدهد که نیاز است تا سیاستها و دیدگاههای مختلف ناشران، سردبیران، دانشمندان و نهادهای نظارتی با هم هماهنگ شوند. این هماهنگی به ایجاد یک دستورالعمل مشترک و روشن برای استفاده مسئولانه از هوش مصنوعی در نوشتن مقالات علمی کمک خواهد کرد. هدف این کرسی این است که دیدگاههای مختلف را جمع کند و راهنمایی ساده، روشن و یکپارچه برای محققان فراهم کند که بر شفافیت، مالکیت، حریم خصوصی و حفظ یکپارچگی کار پژوهشی تأکید داشته باشد.

دکتر احمدی گفتند: این کرسی یا نشست به بررسی مسائل اخلاقی در استفاده از هوش مصنوعی برای نوشتن مقالات علمی میپردازد. هدف این است که با پاسخ دادن به چند سوال مهم، بهتر بفهمیم چه مشکلاتی وجود دارد و چگونه میتوان از این فناوری به شیوهای درست و مسئولانه استفاده کرد.

۱. آیا خوب است که از هوش مصنوعی برای کمک به نوشتن مقالات علمی استفاده کنیم؟

۲. آیا میشود گفت که یک هوش مصنوعی یک "نویسنده" است؟

۳. وقتی یک مطلب با کمک هوش مصنوعی نوشته میشود، چگونه تشخیص دهیم اصیل است یا چیزی شبی سرقت ادبی؟

۴. چه قوانینی لازم است تا استفاده از هوش مصنوعی در نوشتن مقالهها شفاف و منظم باشد؟

۵. آیا باید همیشه بروندادهای هوش مصنوعی را قبل از استفاده بررسی کنیم؟

در پایان احمدی بیان داشتند برای پاسخ به این سوالات، نظرات متخصصان و مقالات علمی منتشر شده در خارج از ایران، همراه با دستورالعملهای مجلات و ناشران معتبر علمی مرور میشوند.

سخنان دبیر جلسه بعد از ارائه کننده:

در پایان سخنان دکتر احمدی بهعنوان ارائهدهنده اصلی نشست، سرکار خانم دکتر عزت رفیعی، دبیر علمی جلسه، در جمعبندی مباحث مطرحشده، بر اهمیت برگزاری چنین نشستهایی برای روشنگری و گفتوگو درباره موضوعات نوپدید و پیچیدهای همچون تعارضات اخلاقی در بهکارگیری هوش مصنوعی تأکید کردند. ایشان خاطرنشان کردند که این نشستها نهتنها برای پژوهشگران و دانشگاهیان، بلکه برای تصمیمگیران، سیاستگذاران، سردبیران مجلات علمی، و نهادهای فعال در حوزه نشر از اهمیت ویژهای برخوردار است، چرا که میتواند به تدوین سیاستهای جامعتر و منسجمتری در مواجهه با این پدیده کمک کند.

دکتر رفیعی ضمن اشاره به ابعاد گسترده استفاده از هوش مصنوعی، فراتر از نگارش مقاله، به موضوع ترجمه کتاب نیز پرداختند و بیان کردند که امروزه شاهد ترجمه روان و دقیق کتابها توسط ابزارهای هوش مصنوعی هستیم، حتی از زبانهایی غیر از انگلیسی به زبان فارسی. با این حال، نگرانیهایی نیز وجود دارد؛ از جمله اینکه در بسیاری از موارد، در گزارشهای ناشران یا مقدمههای مترجمان، بههیچوجه به استفاده از این ابزارها اشارهای نمیشود. ایشان تأکید کردند که این پنهانکاری میتواند موجب خدشه به شفافیت علمی و اعتماد عمومی شود. در پایان، دکتر رفیعی بر ضرورت طراحی سازوکارهایی شفاف برای اعلام و تنظیم استفاده از هوش مصنوعی در تمامی فرایندهای علمی و انتشاراتی، از مقاله نویسی گرفته تا ترجمه کتاب، تأکید کردند.

سخنان ناقد اول

در ادامه نشست علمی–ترویجی «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، جناب آقای دکتر کیانوش چغامیرزا، استاد گروه مهندسی تولید و ژنتیک گیاهی دانشگاه رازی، بهعنوان نخستین ناقد، پس از تقدیر از دکتر احمدی برای ارائه خلاقانه و استقبال شرکتکنندگان، نکاتی را در نقد و تأمل بر محتوای ارائهشده مطرح کرد. وی با تأکید بر اینکه از منظر فنی قصد ورود به جزئیات ندارد، به جایگاه محوری کرسیهای ترویجی در طرح مباحث کلان، و لزوم پرداختن به مسائل روز، بهویژه موضوع هوش مصنوعی، اشاره کرد. دکتر چغامیرزا، ضمن ارج نهادن به منابع و نکاتی که توسط ارائهدهنده مطرح شد، بحث را به حوزه اخلاق در پژوهش معطوف کرد و بیان داشت: اصول اخلاقی در پژوهش، مسائلی روشن و شناختهشده هستند و خط قرمزها برای همه پژوهشگران مشخص است.

وی با مقایسهای تاریخی، ورود هوش مصنوعی به فرآیند پژوهش را مشابه ورود اینترنت به فضای تحقیقاتی دانست و گفت: زمانی پژوهشگران ناچار بودند برای دسترسی به منابع، بهصورت حضوری به کتابخانهها مراجعه کنند؛ اما اینترنت این روند را تسهیل کرد و موجب سرعتبخشی شد، بیآنکه اصول اخلاقی پژوهش تغییر کند. بهزعم ایشان، هوش مصنوعی نیز ابزاری است که میتواند پژوهش را تسهیل کند و در خدمت انسان باشد، اما نباید به آن بیش از حد اعتماد کرد یا از آن ترسید. وی تأکید کرد که استفاده از هوش مصنوعی ذاتاً نگرانکننده نیست، بلکه آنچه اهمیت دارد، حفظ اصول اخلاقی پیشین است.

دکتر چغامیرزا، ضمن مخالفت با نگارش بیانیهها و تدوین قوانین پیچیده پیرامون استفاده از هوش مصنوعی، اظهار داشت که این رویکرد میتواند موجب سردرگمی بیشتر شود. به اعتقاد او، انسان اخلاقمدار در هر شرایطی، چه با ابزار هوش مصنوعی و چه بدون آن، رفتار اخلاقی را حفظ خواهد کرد. وی افزود: «ما میتوانیم از هوش مصنوعی بهخوبی استفاده کنیم، به شرطی که گول آن را نخوریم. در نهایت، تحلیل دادهها و فهم نتایج هنوز به هوش انسانی نیاز دارد.»

او هشدار داد که هرچند این ابزار میتواند سودمند باشد، اما در برخی موارد دچار خطا میشود و نباید بهطور کامل به آن اعتماد کرد؛ چرا که ممکن است اطلاعات نادرست یا گمراهکننده ارائه دهد. دکتر چغامیرزا، معتقد بود هوش مصنوعی، مانند هر فناوری دیگر، قابلیت استفاده درست و نادرست را دارد، و در نهایت این خود پژوهشگر است که باید مراقب بروز بیاخلاقیها باشد.

در پایان، ایشان به تصمیم اخیر وزارت بهداشت درباره ممنوعیت استفاده از هوش مصنوعی در داوری مقالات اشاره کرد و آن را نمونهای از واکنشهای محتاطانه دانست که بهجای حل مسأله، گاهی بر ابهامات میافزایند. او پیشنهاد کرد که بهجای برخوردهای سلبی، بر آموزش و تقویت اخلاق پژوهشی تمرکز شود و اجازه دهیم جامعه علمی در مسیر تعامل سازنده با این فناوری رشد یابد.

سخنان ناقد دوم

در نشست کرسی علمی–ترویجی با عنوان «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، دکتر عبدالله چالهچاله، دانشیار گروه مهندسی کامپیوتر، بهعنوان ناقد دوم سخنان خود را در پی ارائهی دکتر احمدی مطرح کرد. وی ابتدا از ارائهی دکتر احمدی تشکر کرد و عنوان ارائه را خلاقانه و در عین حال ضروری دانست. به نظر وی، عنوان این نشست بهخوبی توانسته بود توجه مخاطبان را جلب کند و در عین حال نیاز روز جامعه علمی را هدف بگیرد.

چالهچاله در ادامه از ادبیات مناسب و سؤالات خوبی که در جریان ارائه مطرح شد، قدردانی کرد، اما به نبود شمارهگذاری در اسلایدها اشاره نمود و آن را از جمله ضعفهای ارائه دانست که میتواند در پیگیری مباحث برای مخاطب ایجاد اشکال کند. همچنین تأکید کرد که ارائه باید در دسترس عموم قرار گیرد تا دیگر محققان و پژوهشگران نیز بتوانند از آن بهره ببرند.

وی نقدی به ساختار ارائه وارد کرد و اظهار داشت که مقدمهای در خصوص تعریف هوش مصنوعی در اسلایدها گنجانده نشده بود و مسائل فنی این حوزه نیز بیان نشد. او پیشنهاد کرد که بهتر بود چند اسلاید ابتدایی به تبیین مفاهیم پایهای هوش مصنوعی اختصاص داده میشد تا زمینهسازی مناسبتری برای مخاطب فراهم گردد.

چالهچاله بهشدت با دیدگاه برخی ناشران که استفاده از هوش مصنوعی را نفی میکنند، مخالفت کرد و این نگاه را غیرمنطقی و ناسازگار با شرایط کنونی جهانی دانست. به اعتقاد وی، این رویکرد از سوی ناشران در آینده تغییر خواهد کرد، زیرا استفاده از هوش مصنوعی در پژوهش، امری اجتنابناپذیر و منطقی است. او با اشاره به اینکه جهان امروز با فناوری در هم تنیده است، گفت که حذف یا نادیده گرفتن هوش مصنوعی، همراستا با واقعیتهای موجود نیست.

وی افزود که تمرکز اصلی ارائهی دکتر احمدی بیشتر بر پردازش متن بود، در حالی که هوش مصنوعی کاربردهای بسیار گستردهتری دارد. به عقیدهی او، لازم بود در سخنرانی به جنبههای متنوع این فناوری نیز پرداخته میشد و نمونههایی از کاربرد آن در حوزههای مختلف ارائه میگردید.

او به مدلهای زبانی بزرگ اشاره کرد و اذعان داشت که این ابزارها میتوانند نقش بسیار مفیدی در نگارش مقالات علمی ایفا کنند. چالهچاله اظهار کرد که نمیتوان صرفاً به این دلیل که متنی با کمک هوش مصنوعی تولید شده، اعتبار آن را زیر سؤال برد. او معتقد است این مدلها قابلیت ارائه ایدههای متنوع، طبقهبندیشده و سازمانیافته را دارند که برای پژوهشگران بسیار ارزشمند است.

در عین حال، چالهچاله به چالشهای این فناوری نیز اشاره کرد. به گفتهی او، خطاها، سوگیریها و اشتباهات دادهای از جمله معایب بالقوه مدلهای زبانی هستند. او نمونههایی از این چالشها را از کشورهای غربی مانند هلند و شرکت آمازون مطرح کرد، که در استفاده از مدلهای مبتنی بر هوش مصنوعی برای ارزیابی رزومهها، به مشکلاتی برخوردند و در نهایت این فناوری را کنار گذاشتند. از نظر او، وجود یک ناظر انسانی در کنار هوش مصنوعی امری ضروری است تا بتوان خطاها را مدیریت کرد و از بروز مشکلات جدی جلوگیری نمود.

دکتر چالهچاله بر این باور بود که با وجود چالشها، استفاده از هوش مصنوعی در حال گسترش است و نتایجی که ارائه میدهد گاه بسیار شگفتانگیز و فراتر از انتظار است. او عملکرد این ابزارها را شبیه به یک انسان توانمند دانست که میتواند پاسخهایی دقیق و کاربردی ارائه دهد. با این حال، تأکید کرد که نقش عامل انسانی نباید نادیده گرفته شود، زیرا حضور انسان در کنار ماشین میتواند احتمال خطا را به حداقل برساند.

او در ادامه سخنانش بیان کرد که دکتر احمدی به مسائل مفید و مهمی، چون اجماع ناشران، توصیههای سیاستی آنان و پیامدهای این روند در آینده اشاره کرد که بسیار ارزشمند بود. با این وجود، از نظر چالهچاله، ایشان بهطور مستقیم وارد طرح چالشها نشدند و بیشتر به تعارضات اشاره کردند، در حالی که انتظار میرفت مباحثی، چون چیستی اخلاق و تعاریف متنوع آن نیز نقد و بررسی شود تا فهم دقیقتری از زمینه بحث حاصل گردد.

دکتر چالهچاله پیشنهاد داد که محتوای این نشست در اختیار معاونت پژوهش و فناوری قرار گیرد تا وزارت علوم، تحقیقات و فناوری بتواند با استفاده از آن موضع رسمی خود را در قالب یک بیانیه اعلام کند. به گفتهی او، وزارتخانه تا امروز در قبال این مسئله سکوت کرده و لازم است سیاستگذاری مشخصی در این زمینه انجام دهد.

او همچنین به توصیههای دکتر احمدی برای ناشران، مجلات و دانشگاهها اشاره کرد و آنها را مفید و کاربردی دانست. وی پیشنهاد کرد که دانشگاه رازی بهعنوان پیشگام از خود شروع کند و برای مجلات علمی وابسته به دانشگاه، سیاستنامهای مشخص در خصوص استفاده از هوش مصنوعی تدوین کند.

پاسخ ارائه دهنده به ناقد اول و دوم

در پی نقدها و پیشنهادهای ارائهشده توسط دکتر چالهچاله و دکتر چقامیرزا در نشست کرسی علمی–ترویجی «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، دکتر احمدی توضیحاتی را در پاسخ به این دیدگاهها مطرح کردند. ایشان در ابتدا تأکید کردند که هدف اصلی این کرسی، پرداختن به دیدگاههای متنوع ناشران، پژوهشگران و نهادهای علمی در خصوص کاربرد هوش مصنوعی در فرآیندهای علمی و پژوهشی بوده است، نه بررسی ابعاد فنی یا تکنولوژیک آن. از همین رو، تمرکز ارائه بر جنبههای اخلاقی، سیاستگذاری و مسائل حوزه نشر علمی قرار داشت.

با این حال، دکتر احمدی ضمن قدردانی از نقدهای سازنده ناقدان، اعلام کردند که پیشنهادهای مطرحشده، از جمله افزودن مقدمهای درباره تعریف هوش مصنوعی، پرداختن اجمالی به جنبههای فنی و اصلاح ساختار اسلایدها، حتماً در نسخه نهایی اسلایدها و متن کتبی نشست مورد توجه قرار خواهد گرفت. ایشان این نظرات را فرصتی برای بهبود محتوای علمی نشست دانستند و از فضای گفتوگوی علمی استقبال کردند.

دکتر احمدی در پاسخ به دیدگاههایی که نقش هوش مصنوعی در تولید دانش را برجسته میکردند، تأکید کردند که به باور ایشان، هوش مصنوعی هنوز نمیتواند جایگزین نویسنده انسانی باشد. او این فناوری را یک «تسهیلگر» در کنار پژوهشگر دانست که میتواند فرآیند تحقیق، دستهبندی، تولید ایده و نگارش را تسریع کند، اما همچنان عامل انسانی در قضاوت، تحلیل و ارزیابی علمی نقش اصلی را ایفا میکند. به گفته دکتر احمدی، استفاده بدون نظارت یا بدون معیارهای شفاف میتواند چالشبرانگیز باشد.

یکی از محورهای مهم پاسخ دکتر احمدی، تأکید بر ضرورت تدوین یک بیانیه یا شیوهنامه رسمی درباره استفاده از هوش مصنوعی در فعالیتهای علمی بود. برخلاف دیدگاه دکتر چقامیرزا که با صدور بیانیه مخالفت داشتند، دکتر احمدی بر این باور بودند که باید هرچه سریعتر یک سند رسمی، شفاف و مبتنی بر اجماع در این خصوص تهیه شود. به گفته ایشان، نبود چنین سندی باعث سردرگمی در جامعه علمی کشور شده و زمینهساز تفسیرهای متناقض و رفتارهای ناهماهنگ خواهد بود.

در ادامه، دکتر احمدی به سیاستهای ناشران بزرگ بینالمللی اشاره کردند و گفتند که بسیاری از این نهادها بهصراحت اعلام کردهاند استفاده از هوش مصنوعی باید بهطور شفاف در مقالات ذکر شود. از این رو، جامعه علمی ما نیز باید از این روند تبعیت کند و در راستای استانداردهای بینالمللی، چارچوبهای مشخصی برای اعلام، کنترل و بهرهبرداری صحیح از هوش مصنوعی تدوین کند.

در پایان، دکتر احمدی ضمن ابراز امیدواری نسبت به تداوم اینگونه نشستهای علمی، خاطرنشان کردند که گفتوگو و نقد، لازمه رشد علمی و سیاستگذاری مؤثر در مواجهه با فناوریهای نوین است و امید است دستاورد این نشست منجر به تصمیمسازیهایی در سطح ملی و دانشگاهی شود.

نقد و پرسشهای حاضران در جلسه

در ادامه نشست کرسی علمی–ترویجی «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، دکتر غلامی، استادیار گروه الهیات دانشگاه رازی، نیز دیدگاههای خود را در این زمینه مطرح کردند. ایشان ضمن تقدیر از دکتر چالهچاله بهدلیل پیشنهاد ارزشمندشان مبنی بر ارسال نتایج این نشست به وزارت علوم، تحقیقات و فناوری، بر ضرورت سیاستگذاری آگاهانه و متناسب با شرایط رشتههای مختلف تأکید کردند.

دکتر غلامی خاطرنشان کرد که نباید از هوش مصنوعی بهصورت یکسان در همه رشتههای علمی بهره گرفت، چرا که هر حوزه علمی ویژگیها، روششناسی و اهداف خاص خود را دارد. بهعنوان نمونه، وی تأکید کرد که در حوزههایی، چون الهیات، مسائل بنیادین و حساس، مانند بحث در مورد وحی، نمیتواند با دادههای تولیدشده توسط هوش مصنوعی – که عمدتاً بر مبنای تحلیل آماری متون و بدون درک معنای عمیق مفاهیم دینی است – مورد بررسی قرار گیرد. ایشان با ذکر مثالی تصریح کردند که استفاده از ابزار هوش مصنوعی در حوزههایی، چون فیزیک پلاسما برای پاسخ به مسائل معرفتی یا وحیانی، از نظر روش علمی و معرفتی قابلقبول نیست.

به باور دکتر غلامی، هوش مصنوعی میتواند در سطح اطلاعات عمومی مفید باشد و به دانشجویان یا محققان کمک کند تا آگاهی کلی از موضوعات پیدا کنند، اما برای پژوهشهای عمیق، تخصصی و تحلیلی که نیاز به درک ظریف مفاهیم دارد، نمیتوان بر آن تکیه کرد. ایشان این فناوری را ابزاری توانمند، اما محدود دانست که باید استفاده از آن با ملاحظات رشتهای، اخلاقی و معرفتی همراه باشد.

در مجموع، سخنان دکتر غلامی بر ضرورت تفکیک و تمایز در استفاده از هوش مصنوعی در رشتههای مختلف علمی تأکید داشت و بر این نکته پافشاری میکرد که سیاستگذاری در این حوزه باید متناسب با ماهیت معرفتشناختی و روششناختی هر حوزه علمی صورت گیرد.

در ادامه نشست علمی یکی از حاضران که عضو هیئت علمی در گروه عمران بود، دیدگاههایی تأملبرانگیز و با رویکرد معرفتی درباره جایگاه هوش مصنوعی در دانشگاهها و نظام علمی کشور مطرح کرد.

این عضو هیئت علمی با نگاهی عمیق و فلسفی، بحث خود را با اشاره به نقش تاریخی دانشگاهها در تولید و گسترش دانایی آغاز کرد و تأکید کرد که هر آنچه به افزایش دانش و بصیرت کمک میکند، باید مورد استقبال قرار گیرد. او با یادآوری دیدگاههای افلاطون درباره پیوند فلسفه و هندسه برای درک حقیقت، بر این نکته تأکید کرد که هوش مصنوعی نیز اگر در خدمت توسعه دانایی باشد، میتواند ابزاری مشروع و مؤثر در فرآیندهای علمی باشد. به باور او، دانشگاه باید هوش مصنوعی را در مسیر ارتقای درک، تحلیل و آفرینش علمی به کار گیرد، نه صرفاً به عنوان ابزار فنی یا تجاری.

وی در ادامه، برخلاف دیدگاه دبیر جلسه که گفته بود هوش مصنوعی هرگز نمیتواند از هوش انسانی فراتر برود، معتقد بود که در برخی عرصهها، خصوصاً در پردازش اطلاعات و تحلیل الگوهای پیچیده، هوش مصنوعی توانسته است به مراتب از توان ذهنی انسان پیشی بگیرد. بنابراین، به جای تقلیل جایگاه این فناوری، باید آن را به رسمیت شناخت و بهدرستی هدایت کرد.

ایشان بر ضرورت شفافیت در استفاده از هوش مصنوعی در محیطهای دانشگاهی تأکید کرد و گفت دانشگاه باید چارچوبهای روشن، قانونی و معرفتی برای کاربرد این ابزار ایجاد کند. فضای علمی نباید در ابهام باقی بماند و لازم است برای استادان، دانشجویان و پژوهشگران مسیر مشخصی در این زمینه ترسیم شود. از نگاه وی، هر فناوری که به افزایش دانایی و رشد علمی کمک کند، باید در دانشگاه جایگاه داشته باشد و آنچه این ویژگی را ندارد، باید کنار گذاشته شود؛ چرا که رسالت دانشگاه چیزی جز جستجوی حقیقت و ارتقای فهم انسانی نیست.

او در پایان یادآور شد که تجارت و توسعه سختافزارهای هوشمند نقش مهمی در پیشرفت زمینههای فنی هوش مصنوعی داشتهاند، اما در حوزه دانشگاه، باید به وجه معرفتی و تأثیر آن بر ساحت علم و دانایی توجه ویژه داشت. به باور او، علم در خدمت تعالی انسان و تسخیر ناشناختههاست، و هوش مصنوعی تنها در صورتی قابل پذیرش است که در همین مسیر به کار گرفته شود.

در جریان نشست کرسی علمی–ترویجی «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، دکتر جمشیدی، استادیار گروه مدیریت فناوریهای نوین از دانشگاه رازی، دیدگاههایی مبتنی بر تجربه و واقعنگری در مورد ضرورت و چالشهای استفاده از هوش مصنوعی در نظام آموزش عالی ارائه دادند.

دکتر جمشیدی با اشاره به پیشرفتهای چشمگیر در فناوریهای هوشمند، تأکید کرد که همانطور که در برخی محیطها رباتها جایگزین انسان شدهاند، زیرا انسان قادر به فعالیت در آن شرایط نبوده است، در فضای علمی و تحلیلی نیز باید پذیرفت که هوش مصنوعی در برخی زمینهها میتواند نقشی اساسی و مکمل ایفا کند. ایشان معتقد بودند که استفاده از این فناوری نهتنها اجتنابناپذیر، بلکه در بسیاری از موارد ضروری است.

وی با بیان تجربههای خود از تعامل با دانشجویان، تصریح کرد که دانشجویان امروزی، با آشنایی بیشتر و سرعت بالاتر، از هوش مصنوعی استفاده میکنند و در برخی موارد حتی بهتر از اساتید از ظرفیتهای آن بهره میبرند. این وضعیت، به باور دکتر جمشیدی، لزوم بازبینی سیاستهای دانشگاه را در نحوه آموزش، ارزشیابی و استفاده از فناوریهای نوین ضروری میسازد.

با این حال، ایشان به یکی از دغدغههای اصلی در این حوزه نیز اشاره کرد و آن، افزایش تقلب در فرآیند آموزش با استفاده از هوش مصنوعی بود. وی هشدار داد که ابزارهای هوشمند در برخی مواقع بهعنوان ابزاری برای دور زدن یادگیری بهکار گرفته میشوند و این موضوع باید با تدوین آییننامههای دقیق و کارآمد کنترل شود.

دکتر جمشیدی همچنین به چرخش در پارادایم اخلاقی اشاره کرد و گفت که مفهوم اخلاق در گذشته، حال و آینده دچار تغییر شده و در تعامل با فناوریهای نوین مانند هوش مصنوعی، باید اخلاق جدیدی بازتعریف و تبیین شود. یکی از حوزههایی که این تغییرات را بهشدت تحتتأثیر قرار داده، حریم خصوصی است. ایشان با اشاره به چالشهای جدی در این حوزه، خواستار تدوین دستورالعملهای مشخص برای حفاظت از دادهها و حقوق کاربران در مواجهه با سیستمهای هوش مصنوعی شدند.

در بخش دیگری از سخنان خود، دکتر جمشیدی به نقش کلیدی دادههای بزرگ اشاره کرد و گفت که در شرایطی که با انبوهی از دادهها مواجه هستیم، استفاده از هوش مصنوعی برای استنتاج، تحلیل و تصمیمگیری نهتنها مفید بلکه ضروری است. وی بهصراحت اعلام کرد که در برخی تحلیلها، هوش مصنوعی از انسان دقیقتر و سریعتر عمل میکند و این واقعیت باید با رویکردی علمی پذیرفته شود، نه با مقاومت سنتی.

در مجموع، دیدگاههای دکتر جمشیدی تأکیدی بود بر پذیرش فعال و مدیریت هوشمندانه هوش مصنوعی در ساختار دانشگاهی، با در نظر گرفتن فرصتها و مخاطرات آن و با هدف بهروزرسانی سیاستهای آموزشی، اخلاقی و اجرایی در آموزش عالی.

در نشست کرسی علمی–ترویجی دکتر اختری از دانشگاه رازی نیز دیدگاههای خود را در خصوص ظرفیتها و الزامات استفاده از هوش مصنوعی در محیطهای علمی و دانشگاهی ارائه دادند.

ایشان در ابتدای سخنان خود بر ضرورت استفاده همهجانبه از هوش مصنوعی تأکید کردند و بیان داشتند که این فناوری میتواند در بسیاری از حوزهها، بهویژه در تحلیل دادههای کلان، نقش تعیینکنندهای ایفا کند. دکتر اختری خاطرنشان کرد که در گذشته تحلیل مجموعههای عظیم داده نیازمند صرف زمان، نیروی انسانی و منابع زیادی بود، اما امروز، با کمک ابزارهای هوش مصنوعی، میتوان در مدت زمانی بسیار کوتاه به نتایجی دقیق و قابل استناد دست یافت.

با این حال، دکتر اختری بر این نکته مهم نیز تأکید کرد که در کنار استفاده گسترده از هوش مصنوعی، وجود ناظر انسانی ضروری است. وی گفت که اتکای مطلق به هوش مصنوعی، بدون بررسی و قضاوت انسانی، میتواند پیامدهای نادیدهای در پی داشته باشد. از این رو، باید بین بهرهگیری از توان تحلیلی هوش مصنوعی و مسئولیتپذیری انسانی تعادل برقرار شود.

یکی دیگر از نکات کلیدی مطرحشده توسط دکتر اختری، لزوم شفافیت در استفاده از هوش مصنوعی در فرآیندهای علمی و آموزشی بود. به گفته ایشان، باید مشخص باشد که در کدام بخشها از این ابزار استفاده شده و نحوه تأثیر آن بر نتایج پژوهش یا فرآیند یادگیری چگونه بوده است. شفافسازی در این زمینه میتواند به افزایش اعتماد و صحت علمی کمک کند.

در پایان، دکتر اختری به مسئله استفاده نامحدود و بدون چارچوب از هوش مصنوعی نیز اشاره کرد و هشدار داد که اگر استفاده از این فناوری بدون کنترل، دستورالعمل و مرزهای اخلاقی مشخص صورت گیرد، ممکن است موجب بیاعتمادی، تقلب یا دستکاری علمی شود. ایشان پیشنهاد کردند که سیاستگذاران دانشگاهی و نهادهای علمی، در کنار بهرهگیری حداکثری از مزایای این فناوری، باید دستورالعملها و محدودیتهایی معقول و دقیق برای کاربرد آن تدوین کنند.

در مجموع، سخنان دکتر اختری تأکیدی بود بر رویکرد متوازن: بهرهگیری گسترده و هوشمندانه از ظرفیتهای هوش مصنوعی، در کنار نهادینهسازی شفافیت و نظارت انسانی در فضای دانشگاهی.

خانم صفری از طریق فضای مجازی دو پرسش فنی مهم در زمینه هوش مصنوعی مطرح کردند که توجه حاضران را به خود جلب کرد. با توجه به تخصصی بودن محتوای این پرسشها، دکتر احمدی، ارائهدهنده جلسه، از دکتر عبدالله چالهچاله، دانشیار گروه مهندسی کامپیوتر دانشگاه رازی، دعوت کردند تا به این سؤالات پاسخ دهند.

پرسش نخست خانم صفری به موضوع تفاوت میان نویسنده انسانی و نویسنده هوش مصنوعی اختصاص داشت. دکتر چالهچاله در پاسخ به این سؤال توضیح دادند که هوش مصنوعی برخلاف انسان، فاقد شعور، نیت، خلاقیت اصیل و مسئولیتپذیری است. به گفته ایشان، آنچه هوش مصنوعی تولید میکند نتیجه تحلیل آماری و یادگیری از دادههای پیشین است، در حالی که نویسنده انسانی با تکیه بر تجربه، دانش، تحلیل مفهومی و ارزشگذاریهای اخلاقی دست به نگارش میزند. بنابراین، نویسنده واقعی انسانی است که مسیر پژوهش را هدایت میکند و از هوش مصنوعی فقط بهعنوان ابزار کمککار بهره میبرد.

پرسش دوم خانم صفری ناظر به شفافیت ابزارهای تشخیص استفاده از هوش مصنوعی بود؛ اینکه آیا میتوان به این ابزارها اعتماد کامل داشت، در حالی که خود آنها نیز مبتنی بر هوش مصنوعی هستند. دکتر چالهچاله در پاسخ با تأکید بر اینکه این ابزارها همچنان در حال توسعه و بهروزرسانی هستند، توضیح دادند که گرچه عملکرد آنها در بسیاری موارد قابل قبول است، اما همچنان با خطاهایی همراه هستند و نمیتوان آنها را معیار نهایی و بیچونوچرا دانست. وی افزود که استفاده از این ابزارها باید همواره با نظارت انسانی همراه باشد تا از بروز اشتباهات و سوگیریهای احتمالی جلوگیری شود.

این بخش از نشست، با طرح سؤالات دقیق و پاسخهای تخصصی، به بررسی جنبههای فنی و اخلاقی استفاده از هوش مصنوعی در نگارش علمی و ابزارهای تشخیصی آن پرداخت و نشان داد که برای رسیدن به یک الگوی اخلاقی و دقیق در استفاده از هوش مصنوعی، نیاز به گفتوگوی مستمر میان متخصصان حوزههای مختلف وجود دارد.

پاسخ ارائه دهنده به حاضران

در پایان نشست کرسی علمی–ترویجی «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، دکتر احمدی، ارائهدهنده اصلی این جلسه، ضمن جمعبندی مباحث و پاسخ به دیدگاههای ناقدان و حاضران، بر همگرایی و نزدیکی دیدگاهها میان ناشران، پژوهشگران و اساتید تأکید کرد.

وی خاطرنشان کرد که آنچه در جریان این نشست روشن شد، وجود اجماع نسبی میان فعالان علمی درباره مشروعیت و ضرورت استفاده از هوش مصنوعی در پژوهشهای علمی است. دکتر احمدی گفت: اکنون کمتر کسی با اصل استفاده از هوش مصنوعی مخالف است، مسئله اصلی شیوه و چارچوب استفاده از آن است.

دکتر احمدی با اشاره به محورهای مهم مطرحشده در جلسه، بر شفافیت بهعنوان اصل اساسی در استفاده از هوش مصنوعی تأکید کرد و گفت باید بهصراحت در فرایند پژوهش مشخص کنیم که در کدام مراحل از ابزارهای هوش مصنوعی بهره بردهایم. وی افزود که مجلات و ناشران علمی نیز باید به این اصل پایبند باشند و از نویسندگان بخواهند موارد استفاده از هوش مصنوعی را بهوضوح اعلام کنند. او تأکید کرد که شفافسازی از سوءاستفاده و تقلب جلوگیری میکند و به ارتقاء اعتبار علمی کمک خواهد کرد.

در بخشی دیگر از سخنان خود، دکتر احمدی به ترس بیمورد از استفاده از هوش مصنوعی اشاره کرد و گفت که نباید این فناوری را به چشم تهدید نگاه کرد، بلکه با رعایت اصول اخلاقی و علمی میتوان از آن بهعنوان یک ابزار تسهیلگر و توانمندساز بهره گرفت. او خاطرنشان کرد: هوش مصنوعی نمیتواند جای پژوهشگر را بگیرد، اما میتواند فرآیند پژوهش را سریعتر و گستردهتر کند.

دکتر احمدی همچنین بر ضرورت تدوین دستورالعملها و آییننامههای مشخص و قابل اجرا در این زمینه تأکید کرد و افزود که برای رفع ابهامها و تعیین حدود و ثغور اخلاقی استفاده از هوش مصنوعی، باید سیاستگذاری روشن و یکپارچه در سطح دانشگاهها، وزارت علوم و جامعه علمی شکل گیرد.

در پایان، وی پیشنهاد کرد که برگزاری نشستهای مشابه بهصورت منظم ادامه پیدا کند تا ابعاد مختلف و جزییات موضوع بیش از پیش روشن شود و در نهایت، جامعه علمی کشور بتواند بدون نگرانی و با رعایت اصول اخلاق پژوهش، از این فناوری نوظهور بهرهمند گردد.

جمع بندی مدیر جلسه

در پایان نشست علمی–ترویجی با عنوان «تحلیل تعارضات اخلاقی بهکارگیری هوش مصنوعی در پژوهشهای علمی»، مدیر جلسه سرکار خانم دکتر رفیعی با ارائه جمعبندیای جامع، بر اهمیت تداوم چنین نشستهایی تأکید کرد. وی اظهار داشت که برگزاری این کرسیها نه تنها به تبیین ابعاد اخلاقی، علمی و فنی هوش مصنوعی در محیطهای دانشگاهی کمک میکند، بلکه زمینه را برای همافزایی بین رشتهای و طرح دیدگاههای متنوع فراهم میسازد.

مدیر جلسه با اشاره به نکات مطرحشده در طول نشست، لزوم اصلاح و تکمیل موارد ارائهشده در متن اصلی این کرسی را یادآور شد تا بهصورت دقیقتر، جامعتر و متناسب با نقدهای سازنده حاضران و ناقدان، نسخه نهایی آن آماده گردد. وی همچنین تأکید کرد که گزارش کامل این نشست باید به مسئولان دانشگاه رازی و در صورت امکان به سایر دانشگاهها نیز ارسال شود تا بتوان از نتایج آن در سیاستگذاریها و تدوین آییننامههای مرتبط با هوش مصنوعی بهره برد.

از دیگر نکات برجسته در سخنان جمعبندیکننده، دعوت از محققان و اساتید دانشگاهی برای ورود فعال به این حوزه بود. وی خاطرنشان کرد که موضوع هوش مصنوعی در پژوهش، پدیدهای نوظهور، اما بسیار مهم است که نیازمند توجه دقیق و مشارکت فعال اندیشمندان از رشتههای مختلف دانشگاهی میباشد.

در پایان، مدیر جلسه از همه شرکتکنندگان، سخنرانان، ناقدان، و حاضران که در شکلگیری این گفتوگوی علمی مؤثر نقش داشتند، صمیمانه تشکر کرد. همچنین، از دکتر بهرامی مدیر کرسی¬های نظریه پردازی دانشگاه رازی و همچنین از سرکار خانم دکتر رستمی به دلیل هماهنگی و مدیریت علمی این نشست قدردانی ویژهای به عمل آورد. این جمعبندی رسمی، بر لزوم استمرار چنین کرسیهایی برای پیشبرد اخلاق و سیاستگذاری علمی در حوزه هوش مصنوعی تأکید داشت.